總結(jié)|圖像分割5大經(jīng)典方法

極市導(dǎo)讀

本文為作者對(duì)圖像分割的5種傳統(tǒng)方法:基于閾值、基于邊緣、基于區(qū)域、基于圖論、基于能量泛函的分割的總結(jié),附有相關(guān)文章的鏈接。 >>加入極市CV技術(shù)交流群,走在計(jì)算機(jī)視覺(jué)的最前沿

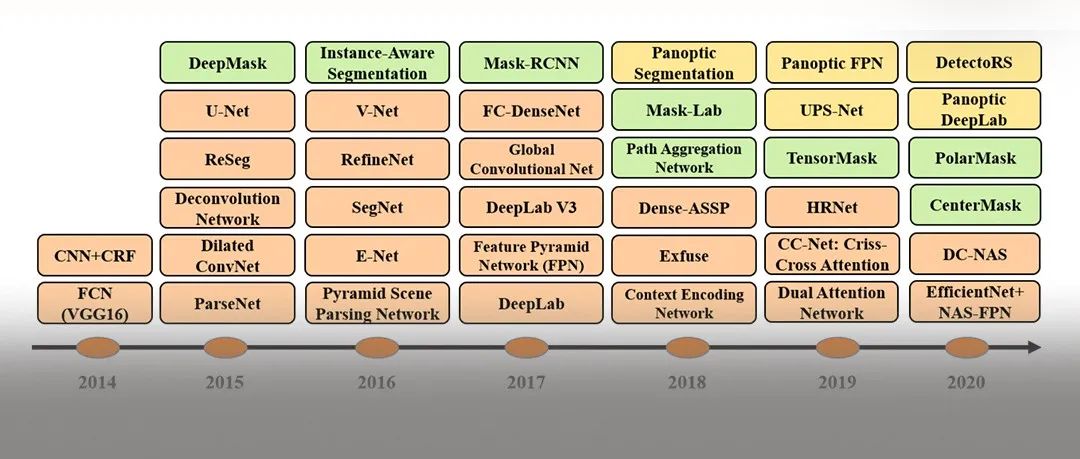

神經(jīng)網(wǎng)絡(luò)部分尚未收集整理。

下面內(nèi)容是從網(wǎng)上獲取整理得出的,且都放了鏈接。

第一次寫(xiě),若侵權(quán)之類(lèi)的麻煩跟我說(shuō)下,我立馬修改。謝謝~ = =

ps: Wiki也有完整介紹

https://www.wiki-wiki.top/zh-hans/%E5%9B%BE%E5%83%8F%E5%88%86%E5%89%B2

圖片分割根據(jù)灰度、顏色、紋理、和形狀等特征將圖像進(jìn)行劃分區(qū)域,讓區(qū)域間顯差異性,區(qū)域內(nèi)呈相似性。主要分割方法有:

基于閾值的分割 基于邊緣的分割 基于區(qū)域的分割 基于圖論的分割 基于能量泛函的分割

基于閾值的分割方法

參考:基于閾值的圖像分割方法

閾值法的基本思想是基于圖像的灰度特征來(lái)計(jì)算一個(gè)或多個(gè)灰度閾值,并將圖像中每個(gè)像素的灰度值與閾值相比較,最后將像素根據(jù)比較結(jié)果分到合適的類(lèi)別中。因此,該類(lèi)方法最為關(guān)鍵的一步就是按照某個(gè)準(zhǔn)則函數(shù)來(lái)求解最佳灰度閾值。

固定閾值分割:

固定某像素值為分割點(diǎn)。 直方圖雙峰法:

Prewitt 等人于六十年代中期提出的直方圖雙峰法(也稱(chēng) mode 法) 是典型的全局單閾值分割方法。該方法的基本思想是:假設(shè)圖像中有明顯的目標(biāo)和背景,則其灰度直方圖呈雙峰分布,當(dāng)灰度級(jí)直方圖具有雙峰特性時(shí),選取兩峰之間的谷對(duì)應(yīng)的灰度級(jí)作為閾值。如果背景的灰度值在整個(gè)圖像中可以合理地看作為恒定,而且所有物體與背景都具有幾乎相同的對(duì)比度,那么,選擇一個(gè)正確的、固定的全局閾值會(huì)有較好的效果.算法實(shí)現(xiàn):找到第一個(gè)峰值和第二個(gè)峰值,再找到第一和第二個(gè)峰值之間的谷值,谷值就是那個(gè)閥值了。 迭代閾值圖像分割:

1.統(tǒng)計(jì)圖像灰度直方圖,求出圖象的最大灰度值和最小灰度值,分別記為ZMAX和ZMIN,令初始閾值T0=(ZMAX+ZMIN)/2; 2. 根據(jù)閾值TK將圖象分割為前景和背景,計(jì)算小于TO所有灰度的均值ZO,和大于TO的所有灰度的均值ZB。 3. 求出新閾值TK+1=(ZO+ZB)/2; 4. 若TK==TK+1,則所得即為閾值;否則轉(zhuǎn)2,迭代計(jì)算。 自適應(yīng)閾值圖像分割: 有時(shí)候物體和背景的對(duì)比度在圖像中不是處處一樣的,普通閾值分割難以起作用。這時(shí)候可以根據(jù)圖像的局部特征分別采用不同的閾值進(jìn)行分割。只要我們將圖像分為幾個(gè)區(qū)域,分別選擇閾值,或動(dòng)態(tài)地根據(jù)一定鄰域范圍選擇每點(diǎn)處的閾值,從而進(jìn)行圖像分割。

把圖像分成m*n塊子圖,求取每一塊子圖的灰度均值就是所有像素灰度值之和除以像素點(diǎn)的數(shù)量,這個(gè)均值就是閾值了。這種方法明顯不比大津法好,因?yàn)榫捣ê痛蠼蚍ǘ际菑膱D像整體來(lái)考慮閾值的,但是大津法找了一個(gè)類(lèi)間方差最大值來(lái)求出最佳閾值的;這兩種方法子圖越多應(yīng)該分割效果會(huì)好一點(diǎn),但效率可能會(huì)變慢 日本學(xué)者大津在1979年提出的自適應(yīng)閾值確定方法。按照?qǐng)D像的灰度特性,將圖像分為背景和目標(biāo)兩部分。背景和目標(biāo)之間的類(lèi)間方差越大,說(shuō)明構(gòu)成圖像的2部分的差別越大,當(dāng)部分目標(biāo)錯(cuò)分為背景或部分背景錯(cuò)分為目標(biāo)都會(huì)導(dǎo)致2部分差別變小。因此,使類(lèi)間方差最大的分割意味著錯(cuò)分概率最小。 大津法 OTSU (最大類(lèi)間方差法):

均值法:

最佳閾值:

閾值選擇需要根據(jù)具體問(wèn)題來(lái)確定,一般通過(guò)實(shí)驗(yàn)來(lái)確定。如對(duì)某類(lèi)圖片,可以分析其直方圖等。

基于邊緣的分割方法

參考:圖像分割之(一)概述

https://blog.csdn.net/zouxy09/article/details/8532106

圖像中兩個(gè)不同區(qū)域的邊界線上連續(xù)的像素點(diǎn)的集合,是圖像局部特征不連續(xù)性的反映,體現(xiàn)了灰度、顏色、紋理等圖像特性的突變。通常情況下,基于邊緣的分割方法指的是基于灰度值的邊緣檢測(cè),它是建立在邊緣灰度值會(huì)呈現(xiàn)出階躍型或屋頂型變化這一觀測(cè)基礎(chǔ)上的方法。階躍型邊緣兩邊像素點(diǎn)的灰度值存在著明顯的差異,而屋頂型邊緣則位于灰度值上升或下降的轉(zhuǎn)折處。正是基于這一特性,可以使用微分算子進(jìn)行邊緣檢測(cè),即使用一階導(dǎo)數(shù)的極值與二階導(dǎo)數(shù)的過(guò)零點(diǎn)來(lái)確定邊緣,具體實(shí)現(xiàn)時(shí)可以使用圖像與模板進(jìn)行卷積來(lái)完成。

邊緣角點(diǎn)和興趣點(diǎn)的檢測(cè)器有:

SIFT的改進(jìn)版。 尺度不變特征轉(zhuǎn)換,檢測(cè)是用來(lái)識(shí)別興趣點(diǎn)的第二中方法。不同與Harris角點(diǎn)檢測(cè)器,SIFT將尺度和方向與結(jié)果中的興趣點(diǎn)相關(guān)聯(lián)。為了找到興趣點(diǎn),,交替使用多種算子。《計(jì)算機(jī)視覺(jué):模型、學(xué)習(xí)和推理》第13章(http://125.216.241.100:51004/view/29) 對(duì)每個(gè)點(diǎn)周?chē)乃椒较虼怪狈较虻膿?jù)ubu梯度進(jìn)行考慮。目的在于找到圖像中亮度在兩個(gè)方向上均發(fā)生變化的點(diǎn),而非一個(gè)方向(一條邊緣)或者零個(gè)方向(平坦區(qū)域)。Harris角點(diǎn)檢測(cè)器是基于對(duì)圖像結(jié)構(gòu)張量的決策。《計(jì)算機(jī)視覺(jué):模型、學(xué)習(xí)和推理》第13章 將圖像P模糊化,然后與一堆正交微分濾波器(如Prewitt濾波器)做卷積生成分別包括水平和垂直方向上的導(dǎo)數(shù)的圖像H和V,對(duì)像素(i,j)計(jì)算其梯度方向和幅度。若幅度超過(guò)臨界值就分配一條邊緣(此處稱(chēng)為閾值法,但效果不佳)。canny使用非極大抑制的方法對(duì)那些不需要響應(yīng)的進(jìn)行刪除。《計(jì)算機(jī)視覺(jué):模型、學(xué)習(xí)和推理》第13章 Canny邊緣檢測(cè)器:

Harris角點(diǎn)檢測(cè)器:

SIFT檢測(cè)器:

SURF檢測(cè)器 *

基于區(qū)域的分割方法

參考:圖像分割之(一)概述 https://blog.csdn.net/zouxy09/article/details/8532106

按照?qǐng)D像的相似性準(zhǔn)則劃分為不同區(qū)域塊。主要有種子區(qū)域生長(zhǎng)法、區(qū)域分裂合并法、分水嶺法等。

種子區(qū)域生長(zhǎng)法

根據(jù)統(tǒng)一物體區(qū)域的像素相似性來(lái)聚集像素點(diǎn)達(dá)到區(qū)域生長(zhǎng)的方法。其中由一組表示不同區(qū)域的種子像素開(kāi)始,逐步合并種子周?chē)嗨频南袼貜亩鴶U(kuò)大區(qū)域。直到無(wú)法合并像素點(diǎn)或小領(lǐng)域?yàn)橹埂F渲袇^(qū)域內(nèi)的相似性的度量可用平均灰度值、紋理、顏色等等信息。關(guān)鍵在于選擇初始種子像素及生長(zhǎng)準(zhǔn)則。最早的區(qū)域生長(zhǎng)圖像分割方法是由Levine等人提出。 區(qū)域分裂合并法

區(qū)域分裂合并法(Gonzalez,2002),確定分裂合并的準(zhǔn)則,然后將圖像任意分成若干互不相交的區(qū)域,按準(zhǔn)則對(duì)這些區(qū)域進(jìn)行分裂合并。它可用于灰度圖像分割及紋理圖像分割。 分水嶺法

分水嶺法(Meyer,1990)是一種基于拓?fù)淅碚摰臄?shù)學(xué)形態(tài)學(xué)的分割方法,其基本思想是把圖像看作是測(cè)地學(xué)上的拓?fù)涞孛玻瑘D像中每一點(diǎn)像素的灰度值表示該點(diǎn)的海拔高度,每一個(gè)局部極小值及其影響區(qū)域稱(chēng)為集水盆,而集水盆的邊界則形成分水嶺。該算法的實(shí)現(xiàn)可以模擬成洪水淹沒(méi)的過(guò)程,圖像的最低點(diǎn)首先被淹沒(méi),然后水逐漸淹沒(méi)整個(gè)山谷。當(dāng)水位到達(dá)一定高度的時(shí)候?qū)?huì)溢出,這時(shí)在水溢出的地方修建堤壩,重復(fù)這個(gè)過(guò)程直到整個(gè)圖像上的點(diǎn)全部被淹沒(méi),這時(shí)所建立的一系列堤壩就成為分開(kāi)各個(gè)盆地的分水嶺。分水嶺算法對(duì)微弱的邊緣有著良好的響應(yīng),但圖像中的噪聲會(huì)使分水嶺算法產(chǎn)生過(guò)分割的現(xiàn)象

基于圖論的分割方法

參考:圖像分割之(一)概述 https://blog.csdn.net/zouxy09/article/details/8532106

此類(lèi)方法把圖像分割問(wèn)題與圖的最小割(min cut)問(wèn)題相關(guān)聯(lián)。首先將圖像映射為帶權(quán)無(wú)向圖G=,圖中每個(gè)節(jié)點(diǎn)N∈V對(duì)應(yīng)于圖像中的每個(gè)像素,每條邊∈E連接著一對(duì)相鄰的像素,邊的權(quán)值表示了相鄰像素之間在灰度、顏色或紋理方面的非負(fù)相似度。而對(duì)圖像的一個(gè)分割s就是對(duì)圖的一個(gè)剪切,被分割的每個(gè)區(qū)域C∈S對(duì)應(yīng)著圖中的一個(gè)子圖。而分割的最優(yōu)原則就是使劃分后的子圖在內(nèi)部保持相似度最大,而子圖之間的相似度保持最小。基于圖論的分割方法的本質(zhì)就是移除特定的邊,將圖劃分為若干子圖從而實(shí)現(xiàn)分割。目前所了解到的基于圖論的方法有GraphCut,GrabCut和Random Walk等。

GraphCut 圖割

算法基于灰度圖; 需要人工標(biāo)注至少一個(gè)前景點(diǎn)和一個(gè)背景點(diǎn); 結(jié)果為硬分割結(jié)果,未考慮邊緣介于0~1之間的透明度。 Boykov Y Y, Jolly M P. Interactive graph cuts for optimal boundary & region segmentation of objects in N-D images[C]// IEEE International Conference on Computer Vision. IEEE Computer Society, 2001:105. 圖像分割之(二)Graph Cut(圖割)(https://blog.csdn.net/zouxy09/article/details/8532111) 參考:

非常有用和流行的能量?jī)?yōu)化算法,在計(jì)算機(jī)視覺(jué)領(lǐng)域普遍應(yīng)用于前背景分割(Image segmentation)、立體視覺(jué)(stereo vision)、摳圖(Image matting)等。

將一幅圖像分為目標(biāo)和背景兩個(gè)不相交的部分,那就相當(dāng)于完成了圖像分割。

此類(lèi)方法把圖像分割問(wèn)題與圖的最小割(min cut)問(wèn)題相關(guān)聯(lián)。最小割把圖的頂點(diǎn)劃分為兩個(gè)不相交的子集S和T。這兩個(gè)子集就對(duì)應(yīng)于圖像的前景像素集和背景像素集。可以通過(guò)最小化圖割來(lái)最小化能量函數(shù)得到。能量函數(shù)由區(qū)域項(xiàng)(regional term)和邊界項(xiàng)(boundary term)構(gòu)成。

整個(gè)流程的限制是:

GrabCut 分割和摳圖

Graph Cut的目標(biāo)和背景的模型是灰度直方圖,Grab Cut取代為RGB三通道的混合高斯模型GMM; Graph Cut的能量最小化(分割)是一次達(dá)到的,而Grab Cut取代為一個(gè)不斷進(jìn)行分割估計(jì)和模型參數(shù)學(xué)習(xí)的交互迭代過(guò)程; Graph Cut需要用戶(hù)指定目標(biāo)和背景的一些種子點(diǎn),但是Grab Cut只需要提供背景區(qū)域的像素集就可以了。也就是說(shuō)你只需要框選目標(biāo),那么在方框外的像素全部當(dāng)成背景,這時(shí)候就可以對(duì)GMM進(jìn)行建模和完成良好的分割了。即Grab Cut允許不完全的標(biāo)注(incomplete labelling)。 將基于灰度分布的模型替換為高斯混合模型(Gaussian Mixture Model,GMM)以支持彩色圖片; 將能一次性得到結(jié)果的算法改成了『強(qiáng)大的』迭代流程;將用戶(hù)的交互簡(jiǎn)化到只需要框選前景物體即可。 Rother C, Kolmogorov V, Blake A. "GrabCut": interactive foreground extraction using iterated graph cuts[J]. Acm Transactions on Graphics, 2004, 23(3):309-314. 讀《"GrabCut" -- Interactive Foreground Extraction using Iterated Graph Cuts》(https://zhuanlan.zhihu.com/p/20255114) 圖像分割之(三)從Graph Cut到Grab Cut(https://blog.csdn.net/zouxy09/article/details/8534954) 參考:

是Graphcut圖隔的改進(jìn)版,是迭代的GraphCut。改進(jìn)包括:

與Graph Cut不同處:

彩色像素值的稀疏問(wèn)題比灰度圖要嚴(yán)重得多(256 vs 17M),所以,繼續(xù)使用histogram是不現(xiàn)實(shí)的,需要信息壓縮得更好一點(diǎn)的模型,作者在這里參考前人,對(duì)前景和背景各建了K=5的高斯混合模型。

GrabCut是按顏色分布和邊緣對(duì)比度來(lái)分割圖片的,對(duì)一些常見(jiàn)的與此原則相悖的圖片,效果確實(shí)不好。比如前景人物的帽子、鞋、墨鏡,通常顏色跟前景主體有較大區(qū)別;再如前景中的孔,有可能由于顏色區(qū)分和邊緣的對(duì)比度不足,導(dǎo)致邊緣的懲罰占上風(fēng),而沒(méi)有扣出來(lái)背景。所以,GrabCut還是保留了人工修正的操作,定義了兩種標(biāo)記:絕對(duì)是背景和可能是前景。對(duì)分割錯(cuò)誤人工修正后,分割還是可以比較準(zhǔn)確的。對(duì)自然場(chǎng)景圖片的分割,比Bayes matte等方法得到的邊緣明顯看起來(lái)舒服得多。

基于能量泛函的分割方法

參考:

圖像分割之(一)概述 https://blog.csdn.net/zouxy09/article/details/8532106

該類(lèi)方法主要指的是活動(dòng)輪廓模型(active contour model)以及在其基礎(chǔ)上發(fā)展出來(lái)的算法,其基本思想是使用連續(xù)曲線來(lái)表達(dá)目標(biāo)邊緣,并定義一個(gè)能量泛函使得其自變量包括邊緣曲線,因此分割過(guò)程就轉(zhuǎn)變?yōu)榍蠼饽芰糠汉淖钚≈档倪^(guò)程,一般可通過(guò)求解函數(shù)對(duì)應(yīng)的歐拉(Euler.Lagrange)方程來(lái)實(shí)現(xiàn),能量達(dá)到最小時(shí)的曲線位置就是目標(biāo)的輪廓所在。

活動(dòng)輪廓模型逐漸形成了不同的分類(lèi)方式,較常見(jiàn)的是根據(jù)曲線演化方式的不同,將活動(dòng)輪廓模型分為基于邊界、基于區(qū)域和混合型活動(dòng)輪廓模型。按照模型中曲線表達(dá)形式的不同,活動(dòng)輪廓模型可以分為兩大類(lèi):參數(shù)活動(dòng)輪廓模型(parametric active contour model)和幾何活動(dòng)輪廓模型(geometric active contour model)。

參數(shù)活動(dòng)輪廓模型(parametric active contour model):

參考:

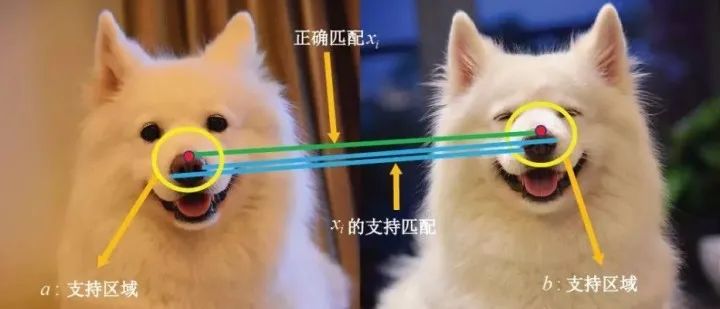

CLM是有約束的局部模型,ASM也屬于CLM的一種。CLM通過(guò)初始化平均臉的位置,然后讓每個(gè)平均臉上的特征點(diǎn)在其鄰域位置上進(jìn)行搜索匹配來(lái)完成人臉點(diǎn)檢測(cè)。整個(gè)過(guò)程分兩個(gè)階段:模型構(gòu)建階段和點(diǎn)擬合階段。模型構(gòu)建階段又可以細(xì)分兩個(gè)不同模型的構(gòu)建:

機(jī)器學(xué)習(xí)理論與實(shí)戰(zhàn)(十六)概率圖模型04(https://blog.csdn.net/marvin521/article/details/11489453) 形狀模型構(gòu)建: 對(duì)人臉模型形狀進(jìn)行建模,說(shuō)白了就是一個(gè)ASM的點(diǎn)分布函數(shù)(PDM),它描述了形狀變化遵循的準(zhǔn)則. Patch模型構(gòu)建: 對(duì)每個(gè)特征點(diǎn)周?chē)徲蜻M(jìn)行建模,也就說(shuō)建立一個(gè)特征點(diǎn)匹配準(zhǔn)則,怎么判斷特征點(diǎn)是最佳匹配. 參考:

ASM是基于統(tǒng)計(jì)形狀模型的基礎(chǔ)上進(jìn)行的,而AAM則是在ASM的基礎(chǔ)上,進(jìn)一步對(duì)紋理(將人臉圖像變形到平均形狀而得到的形狀無(wú)關(guān)圖像)進(jìn)行統(tǒng)計(jì)建模,并將形狀和紋理兩個(gè)統(tǒng)計(jì)模型進(jìn)一步融合為表觀模型。

AAM模型相對(duì)于ASM模型的改進(jìn)為:

Cootes T F, Edwards G J, Taylor C J. Active Appearance Models[C]// European Conference on Computer Vision. Springer Berlin Heidelberg, 1998:484-498. AAM(Active Appearance Model)算法介紹(https://blog.csdn.net/carson2005/article/details/8196996) 使用兩個(gè)統(tǒng)計(jì)模型融合 取代 ASM的灰度模型。 主要對(duì)特征點(diǎn)的特征描述子進(jìn)行了改進(jìn),增加了描述子的復(fù)雜度和魯棒性 參考:

ASM(主動(dòng)形狀模型)是建立在PDM(點(diǎn)分布模型)的基礎(chǔ)上,通過(guò)訓(xùn)練圖像樣本獲取訓(xùn)練圖像樣本的特征點(diǎn)分布的統(tǒng)計(jì)信息,并且獲取特征點(diǎn)允許存在的變化方向,實(shí)現(xiàn)在目標(biāo)圖像上尋找對(duì)應(yīng)的特征點(diǎn)的位置。訓(xùn)練樣本需要手動(dòng)的標(biāo)記所有的特征點(diǎn)的位置,記錄特征點(diǎn)的坐標(biāo),并且計(jì)算每一個(gè)特征點(diǎn)對(duì)應(yīng)的局部灰度模型作為局部特征點(diǎn)調(diào)整用的特征向量。在將訓(xùn)練好的模型放在目標(biāo)圖像上,尋找每一個(gè)特征點(diǎn)的下一個(gè)位置的時(shí)候,采用局部灰度模型尋找在當(dāng)前特征點(diǎn)指定方向上局部灰度模型馬氏距離最小的特征點(diǎn)作為當(dāng)前特征點(diǎn)即將移動(dòng)到的位置,稱(chēng)為suggested point, 找到所有的suggested points就可以獲得一個(gè)搜索的suggested shape, 然后將當(dāng)前的模型通過(guò)調(diào)整參數(shù)使得當(dāng)前的模型最可能相似的調(diào)整到suggest shape,重復(fù)迭代直到實(shí)現(xiàn)收斂。

Cootes T F, Taylor C J. Active Shape Models — ‘Smart Snakes’[M]// BMVC92. Springer London, 1992:266--275. ASM(Active Shape Model) 主動(dòng)形狀模型總結(jié)(https://blog.csdn.net/watkinsong/article/details/8891071) 參考:

在處理如邊緣檢測(cè)、角點(diǎn)識(shí)別、動(dòng)態(tài)跟蹤以及立體匹配等任務(wù)上非常成功。

SNAKE模型就是一條可變形的參數(shù)曲線及相應(yīng)的能量函數(shù),以最小化能量目標(biāo)函數(shù)為目標(biāo),控制參數(shù)曲線變形,具有最小能量的閉合曲線就是目標(biāo)輪廓。模型的形變受到同時(shí)作用在模型上的許多不同的力所控制,每一種力所產(chǎn)生一部分能量,這部分能量表示為活動(dòng)輪廓模型的能量函數(shù)的一個(gè)獨(dú)立的能量項(xiàng)。

基本Snakes模型的能量函數(shù)由三項(xiàng)組成,彈性能量和彎曲能量合稱(chēng)內(nèi)部能量(內(nèi)部力),用于控制輪廓線的彈性形變,起到保持輪廓連續(xù)性和平滑性的作用。而第三項(xiàng)代表外部能量,也被稱(chēng)為圖像能量,表示變形曲線與圖像局部特征吻合的情況。內(nèi)部能量?jī)H僅跟snake的形狀有關(guān),而跟圖像數(shù)據(jù)無(wú)關(guān)。而外部能量?jī)H僅跟圖像數(shù)據(jù)有關(guān)。在某一點(diǎn)的α和β的值決定曲線可以在這一點(diǎn)伸展和彎曲的程度。最終對(duì)圖像的分割轉(zhuǎn)化為求解能量函數(shù)Etotal(v)極小化(最小化輪廓的能量)。在能量函數(shù)極小化過(guò)程中,彈性能量迅速把輪廓線壓縮成一個(gè)光滑的圓,彎曲能量驅(qū)使輪廓線成為光滑曲線或直線,而圖像力則使輪廓線向圖像的高梯度位置靠攏。基本Snakes模型就是在這3個(gè)力的聯(lián)合作用下工作的。

snake相對(duì)于經(jīng)典的特征提取方法有以下優(yōu)點(diǎn):

snake的缺點(diǎn):

Michael Kass et al. Snakes: Active contour models. International Journal of Computer Vision, pages 321-331, 1987. 圖像分割之(五)活動(dòng)輪廓模型之Snake模型簡(jiǎn)介(https://blog.csdn.net/zouxy09/article/details/8712287) 計(jì)算機(jī)視覺(jué)之圖像分割——Snake模型(1譯文)(https://blog.csdn.net/VictoriaW/article/details/59110318) 通過(guò)正確設(shè)置和項(xiàng)前系數(shù),可交互方式控制snake; 容易操控,因?yàn)閳D像力是以直觀的方式表現(xiàn); 在尋找最小能量狀態(tài)的時(shí)候它們是自主的和自適應(yīng)的; 可以通過(guò)在圖像能量函數(shù)中加入高斯平滑而對(duì)圖像尺度敏感; 可以用于跟蹤時(shí)間或者空間維度上的動(dòng)態(tài)目標(biāo)。 初始位置不同使得結(jié)果不同; 經(jīng)常陷入局部最小狀態(tài),這也許可以通過(guò)使用模擬退火技術(shù)來(lái)克服,代價(jià)就是計(jì)算時(shí)間增加; 在最小化整個(gè)輪廓路徑上的能量過(guò)程中經(jīng)常忽略微小特征; 精度由能量最小化技術(shù)中使用的收斂標(biāo)準(zhǔn)控制;更高的精度要求更嚴(yán)格的收斂標(biāo)準(zhǔn),因此需要更長(zhǎng)的計(jì)算時(shí)間。 參數(shù)活動(dòng)輪廓模型基于Lagrange框架,直接以曲線的參數(shù)化形式來(lái)表達(dá)曲線,最具代表性的是由Kasset a1(1987)所提出的Snake模型。該類(lèi)模型在早期的生物圖像分割領(lǐng)域得到了成功的應(yīng)用,但其存在著分割結(jié)果受初始輪廓的設(shè)置影響較大以及難以處理曲線拓?fù)浣Y(jié)構(gòu)變化等缺點(diǎn),此外其能量泛函只依賴(lài)于曲線參數(shù)的選擇,與物體的幾何形狀無(wú)關(guān),這也限制了其進(jìn)一步的應(yīng)用。

Snake模型:

ASM(Active Shape Model)

AAM(Active Appearance Models)

CLM(Constrained local model)有約束的局部模型

幾何活動(dòng)輪廓模型(geometric active contour model):

·S.Osher,J.A.Sethian,Fronts propagating with curvature dependent speed:algorithms basedon Hamilton-Jacobi formulations.Journal of Computational Physics,1988,79:12—49 圖像分割___圖像分割方法綜述(https://blog.csdn.net/vast_sea/article/details/8196507) 參考:

幾何活動(dòng)輪廓模型的曲線運(yùn)動(dòng)過(guò)程是基于曲線的幾何度量參數(shù)而非曲線的表達(dá)參數(shù),因此可以較好地處理拓?fù)浣Y(jié)構(gòu)的變化,并可以解決參數(shù)活動(dòng)輪廓模型難以解決的問(wèn)題。而水平集(Level Set)方法(Osher,1988)的引入,則極大地推動(dòng)了幾何活動(dòng)輪廓模型的發(fā)展,因此幾何活動(dòng)輪廓模型一般也可被稱(chēng)為水平集方法。

幾何活動(dòng)輪廓模型(Geometric Active Contours Model)是以曲線演化理論和水平集方法為理論基礎(chǔ),繼參數(shù)活動(dòng)輪廓模型后形變模型的又一發(fā)展,是圖像分割和邊界提取的重要工具之一。相對(duì)于參數(shù)活動(dòng)輪廓模型,幾何活動(dòng)輪廓模型具有很多優(yōu)點(diǎn),如可以處理曲線的拓?fù)渥兓?duì)初始位置不敏感、具有穩(wěn)定的數(shù)值解等.

幾何活動(dòng)輪廓模型又可分為基于邊界的活動(dòng)輪廓模型、基于區(qū)域的活動(dòng)輪廓模型。基于邊界的活動(dòng)輪廓模型主要依賴(lài)圖像的邊緣信息控制曲線的運(yùn)動(dòng)速度。在圖像邊緣強(qiáng)度較弱或是遠(yuǎn)離邊緣的地方,輪廓曲線運(yùn)動(dòng)速度較大,而在圖像邊緣強(qiáng)度較強(qiáng)的地方,輪廓曲線運(yùn)動(dòng)速度較小甚至停止,使得最終的輪廓曲線運(yùn)動(dòng)到邊緣位置.

傳統(tǒng)方法的收集大致結(jié)束。

推薦閱讀

2021-01-25

2021-02-14

2021-02-05

# CV技術(shù)社群邀請(qǐng)函 #

備注:姓名-學(xué)校/公司-研究方向-城市(如:小極-北大-目標(biāo)檢測(cè)-深圳)

即可申請(qǐng)加入極市目標(biāo)檢測(cè)/圖像分割/工業(yè)檢測(cè)/人臉/醫(yī)學(xué)影像/3D/SLAM/自動(dòng)駕駛/超分辨率/姿態(tài)估計(jì)/ReID/GAN/圖像增強(qiáng)/OCR/視頻理解等技術(shù)交流群

每月大咖直播分享、真實(shí)項(xiàng)目需求對(duì)接、求職內(nèi)推、算法競(jìng)賽、干貨資訊匯總、與 10000+來(lái)自港科大、北大、清華、中科院、CMU、騰訊、百度等名校名企視覺(jué)開(kāi)發(fā)者互動(dòng)交流~