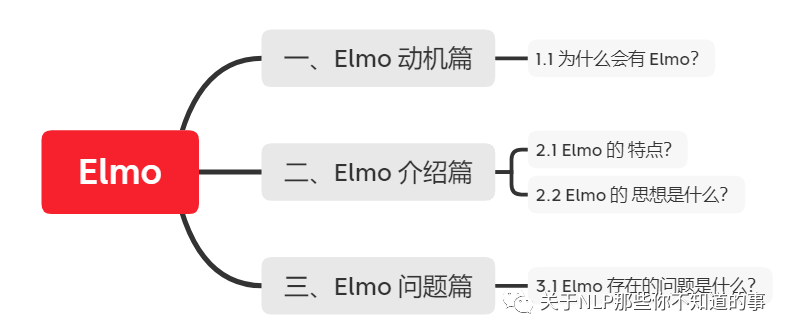

【關(guān)于 Elmo】 那些你不知道的事

作者:楊夕

項(xiàng)目地址:https://github.com/km1994/NLP-Interview-Notes

個(gè)人論文讀書(shū)筆記:https://github.com/km1994/nlp_paper_study

【注:手機(jī)閱讀可能圖片打不開(kāi)!!!】

一、Elmo 動(dòng)機(jī)篇

1.1 為什么會(huì)有 Elmo?

多義詞問(wèn)題:

因?yàn)?one-hot、word2vec、fastText 為靜態(tài)方式,即訓(xùn)練好后,每個(gè)詞表達(dá)固定;

單向性:

因?yàn)?one-hot、word2vec、fastText 都是 從左向右 學(xué)習(xí),導(dǎo)致該方法 不能 同時(shí)考慮 兩邊信息;

二、Elmo 介紹篇

2.1 Elmo 的 特點(diǎn)?

基于特征融合 的 word emb

2.2 Elmo 的 思想是什么?

預(yù)訓(xùn)練時(shí),使用語(yǔ)言模型學(xué)習(xí)一個(gè)單詞的emb(多義詞無(wú)法解決);

使用時(shí),單詞間具有特定上下文,可根據(jù)上下文單詞語(yǔ)義調(diào)整單詞的emb表示(可解決多義詞問(wèn)題)

理解:因?yàn)轭A(yù)訓(xùn)練過(guò)程中,emlo 中 的 lstm 能夠?qū)W習(xí)到 每個(gè)詞 對(duì)應(yīng)的 上下文信息,并保存在網(wǎng)絡(luò)中,在 fine-turning 時(shí),下游任務(wù) 能夠?qū)?該 網(wǎng)絡(luò)進(jìn)行 fine-turning,使其 學(xué)習(xí)到新特征;

三、Elmo 問(wèn)題篇

3.1 Elmo 存在的問(wèn)題是什么?

在做序列編碼任務(wù)時(shí),使用 LSTM;

ELMo 采用雙向拼接的融合特征,比Bert一體化融合特征方式弱;

參考資料

神經(jīng)網(wǎng)路語(yǔ)言模型(NNLM)的理解

NLP 面試題(一)和答案,附有參考URL