英偉達(dá)H100將在2024年之前售罄!推理GPU根本不夠用,AI初創(chuàng)公司急了

新智元報(bào)道

新智元報(bào)道

【新智元導(dǎo)讀】據(jù)悉,英偉達(dá)H100 GPU在2024年之前基本已售罄。AI初創(chuàng)公司真的開始急了。

英偉達(dá)最好的芯片H100,在2024年之前就會售罄!

這一消息,讓AI初創(chuàng)公司們開始揪心了。

現(xiàn)在,我們已經(jīng)進(jìn)入了一個(gè)GPU至上的時(shí)代。

英偉達(dá)的芯片,現(xiàn)在已經(jīng)成為了科技行業(yè)最寶貴的資源。

無論是大廠還是初創(chuàng)企業(yè),都在瘋狂地把預(yù)算從其他項(xiàng)目轉(zhuǎn)到AI項(xiàng)目上,對GPU的需求日益旺盛。

臺積電:所有產(chǎn)品需求都降低了,除了英偉達(dá)的芯片

臺積電為英偉達(dá)制造的圖形處理單元GPU,主導(dǎo)著AI應(yīng)用的半導(dǎo)體市場。

英偉達(dá)的高端H100 GPU非常適合訓(xùn)練AI模型、服務(wù)客戶所需的并行式計(jì)算。而如今隨著生成式AI的熱潮,H100已經(jīng)出現(xiàn)了大量短缺。

4月,GPU市場忽然緊俏起來

但是從4月開始,市場忽然變得異常緊張。交貨時(shí)間甚至推遲到了年底。

而這種轉(zhuǎn)變,發(fā)生在僅僅一周之內(nèi)。

大型企業(yè)和人工智能實(shí)驗(yàn)室的GPU需求,忽然出現(xiàn)了猛增。

而英偉達(dá)最頂級的H100,在當(dāng)前的環(huán)境下,甚至已經(jīng)買不到了。

英偉達(dá)快壟斷了?

表示,英偉達(dá)的護(hù)城河是雙重的。

首先,在硬件方面,沒有人像英偉達(dá)那樣制造芯片。

其次,是在軟件上。上市時(shí)間對于初創(chuàng)企業(yè)來說非常重要。如果用AMD或TPU(谷歌的張量處理單元)重裝整個(gè)技術(shù)堆棧,就會耽誤寶貴的時(shí)間,可能會讓人失去潛在的市場機(jī)會。

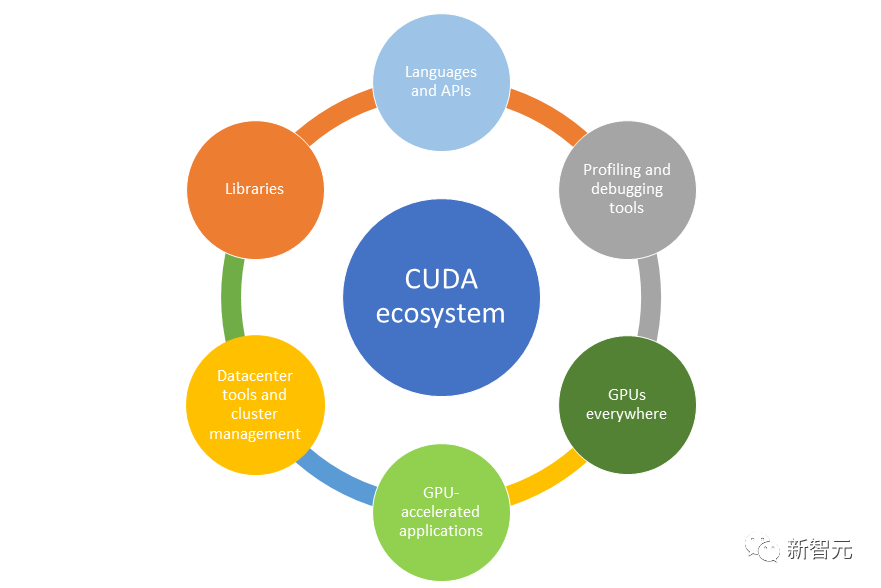

英偉達(dá)在CUDA生態(tài)系統(tǒng)上投入如此之多,是非常有先見之明的。

可以說,他們現(xiàn)在基本上比要比其他人領(lǐng)先10年。

這不僅僅是英偉達(dá)花了10年做的工作,而且是他們的客戶和開發(fā)者CUDA生態(tài)系統(tǒng)上(使用軟件工具和庫),利用了前人的工作。

短期內(nèi),沒有誰能超越英偉達(dá)。

另外,使用谷歌的TPU的問題,被鎖定在具有具體技術(shù)解決方案的供應(yīng)商身上。

作為一家初創(chuàng)公司,這或許不是最佳選擇。他們需要的是具有靈活性的供應(yīng)商,可以讓他們在多個(gè)地方獲得同樣的東西。

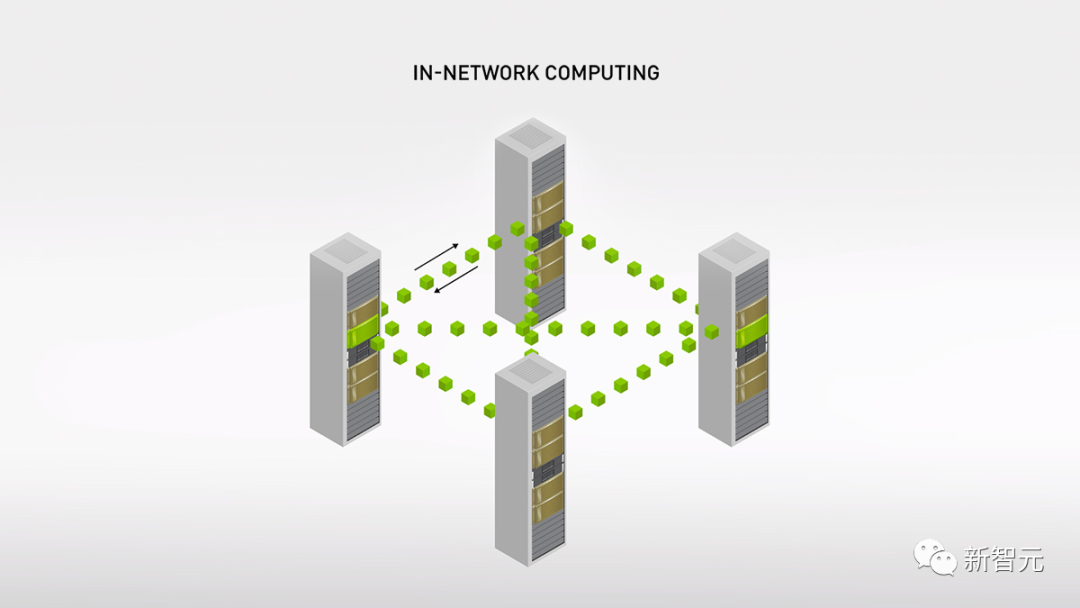

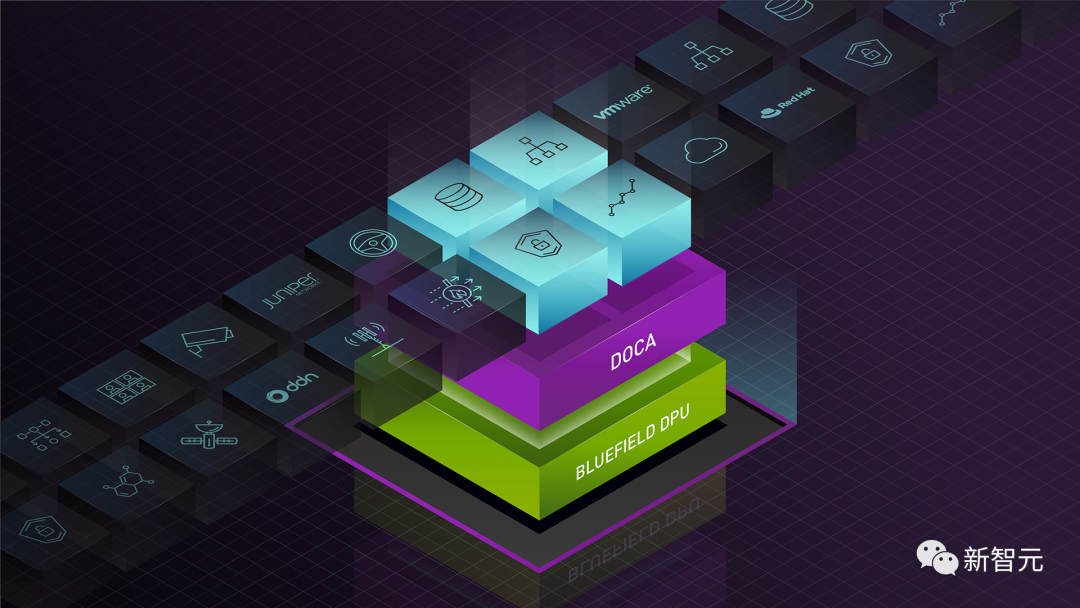

而英偉達(dá)的專有網(wǎng)絡(luò)InfiniBand提供了當(dāng)今最好的解決方案,以最大程度地減少延遲。許多其他產(chǎn)品不具備擁塞控制和功能,無法使工作負(fù)載發(fā)揮最佳性能。

而現(xiàn)在,AI初創(chuàng)公司都很擔(dān)心:當(dāng)他們?nèi)〉蒙虡I(yè)成功時(shí),或許無法擁有足夠的GPU來讓模型推理。

這種需求會讓基礎(chǔ)設(shè)施服務(wù)商興奮,但是從初創(chuàng)公司戰(zhàn)略的角度來講,如何穩(wěn)妥獲取對算力的訪問,幾乎成了一種二元的風(fēng)險(xiǎn)業(yè)務(wù)。

英偉達(dá)GPU已陷短缺風(fēng)暴

OpenAI聯(lián)合創(chuàng)始人兼職科學(xué)家Andrej Karpathy近日也曾發(fā)文,闡述了自己對英偉達(dá)GPU短缺的看法。

近來,社區(qū)廣為流傳的一張圖「我們需要多少張GPU」,引發(fā)了眾多網(wǎng)友的討論。

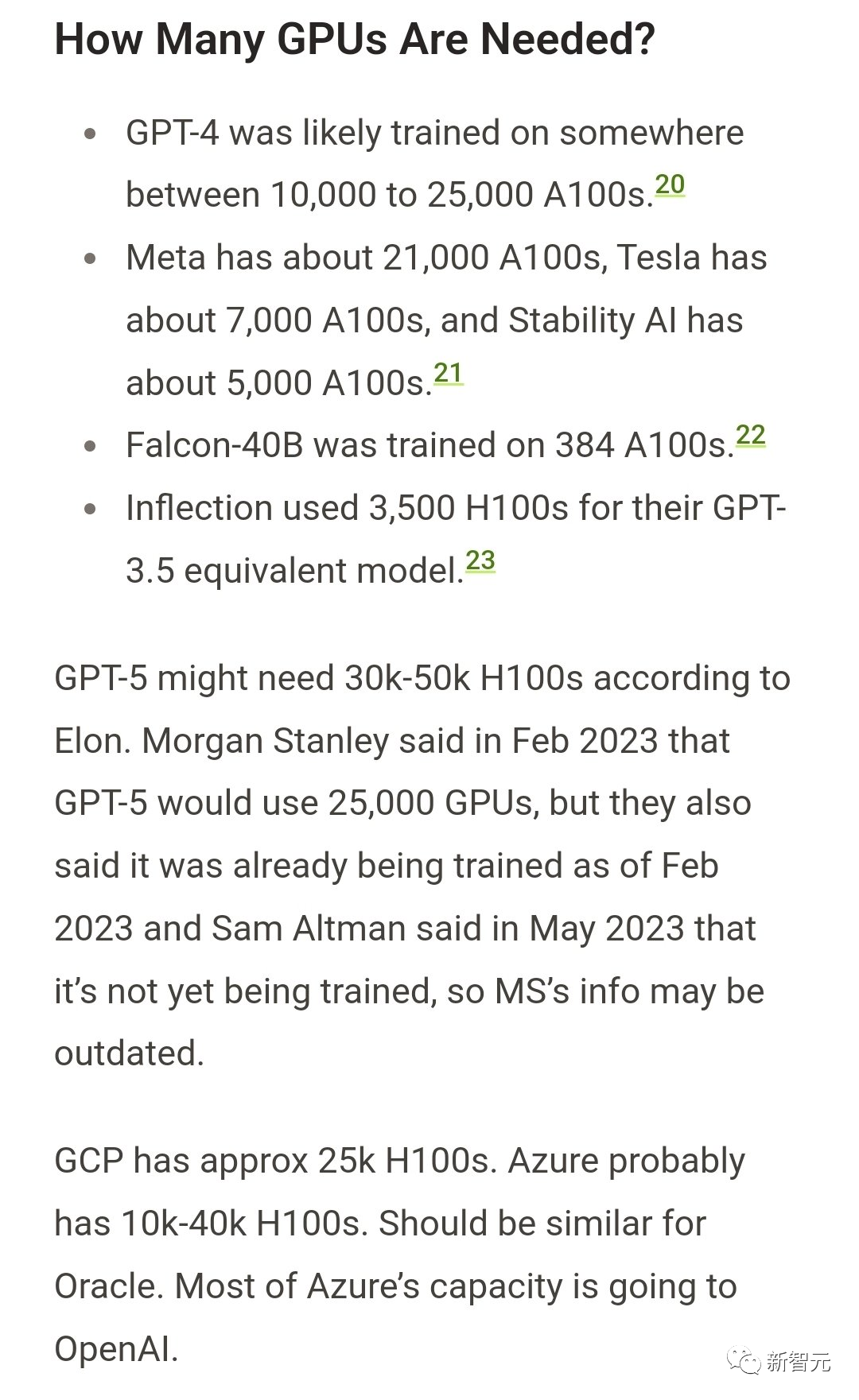

根據(jù)圖中內(nèi)容所示:

- GPT-4可能在大約10000-25000張A100上進(jìn)行了訓(xùn)練

- Meta大約21000 A100- Tesla大約7000 A100

- Stability AI大約5000 A100

- Falcon-40B在384個(gè)A100上進(jìn)行了訓(xùn)練

– Inflection使用了3500和H100,來訓(xùn)練與GPT-3.5能力相當(dāng)?shù)哪P?/span>

另外,根據(jù)馬斯克的說法,GPT-5可能需要30000-50000個(gè)H100。

此前,摩根士丹利曾表示GPT-5使用25000個(gè)GPU,自2月以來已經(jīng)開始訓(xùn)練,不過Sam Altman之后澄清了GPT-5尚未進(jìn)行訓(xùn)。

不過,Altman此前表示,

我們的GPU非常短缺,使用我們產(chǎn)品的人越少越好。

如果人們用的越少,我們會很開心,因?yàn)槲覀儧]有足夠的GPU。

此前,在一篇熱轉(zhuǎn)的「Nvidia H100 GPU:供需」文章中,作者也曾深度剖析了當(dāng)前科技公司們對GPU的使用情況和需求。

文章推測,小型和大型云提供商的大規(guī)模H100集群容量即將耗盡,H100的需求趨勢至少會持續(xù)到2024年底。

總之,老黃是贏麻了。