用Python 爬蟲爬取美劇網(wǎng)站

一直有愛看美劇的習(xí)慣,一方面鍛煉一下英語(yǔ)聽力,一方面打發(fā)一下時(shí)間。之前是能在視頻網(wǎng)站上面在線看的,可是自從廣電總局的限制令之后,進(jìn)口的美劇英劇等貌似就不在像以前一樣同步更新了。但是,作為一個(gè)宅diao的我又怎甘心沒(méi)劇追呢,所以網(wǎng)上隨便查了一下就找到一個(gè)能用迅雷下載的美劇下載網(wǎng)站【天天美劇】,各種資源隨便下載,最近迷上的BBC的高清紀(jì)錄片,大自然美得不要不要的。

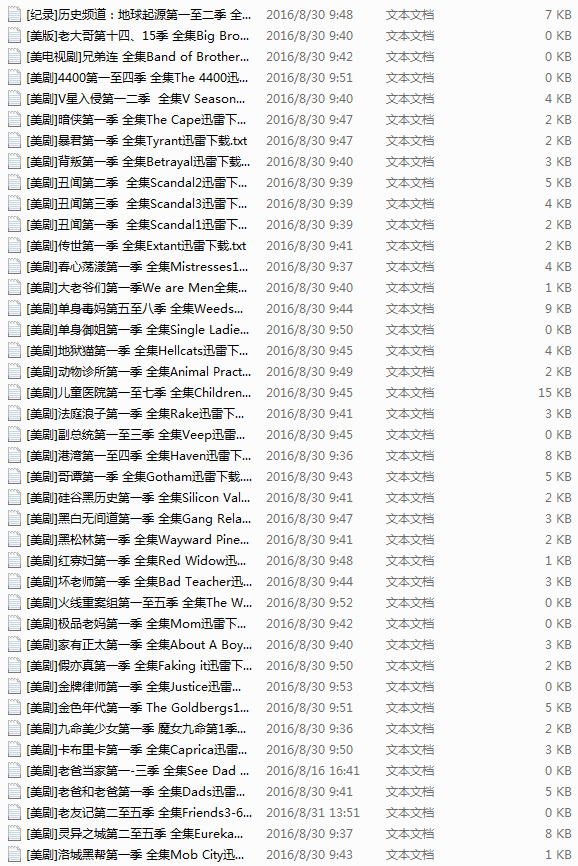

雖說(shuō)找到了資源網(wǎng)站可以下載了,但是每次都要打開瀏覽器,輸入網(wǎng)址,找到該美劇,然后點(diǎn)擊鏈接才能下載。時(shí)間長(zhǎng)了就覺得過(guò)程好繁瑣,而且有時(shí)候網(wǎng)站鏈接還會(huì)打不開,會(huì)有點(diǎn)麻煩。正好一直在學(xué)習(xí)Python爬蟲,所以今天就心血來(lái)潮來(lái)寫了個(gè)爬蟲,抓取該網(wǎng)站上所有美劇鏈接,并保存在文本文檔中,想要哪部劇就直接打開復(fù)制鏈接到迅雷就可以下載啦。

其實(shí)一開始打算寫那種發(fā)現(xiàn)一個(gè) url ,使用 requests 打開抓取下載鏈接,從主頁(yè)開始爬完全站。但是,好多重復(fù)鏈接,還有其網(wǎng)站的 url 不是我想的那么規(guī)則,寫了半天也沒(méi)有寫出我想要的那種發(fā)散式的爬蟲,也許是自己火候還不到吧,繼續(xù)努力。。。

后來(lái)發(fā)現(xiàn),其電視劇鏈接都是在文章里面,然后文章url后面有個(gè)數(shù)字編號(hào),就像這樣的http://cn163.net/archives/24016/,所以機(jī)智的我又用了之前寫過(guò)的爬蟲經(jīng)驗(yàn),解決方法就是自動(dòng)生成url,其后面的數(shù)字不是可以變的嗎,而且每部劇的都是唯一的,所以嘗試了一下大概有多少篇文章,然后用range函數(shù)直接連續(xù)生成數(shù)來(lái)構(gòu)造url。

但是很多 url 是不存在的,所以會(huì)直接掛掉,別擔(dān)心,我們用的可是 requests ,其自帶的 status_code 就是用來(lái)判斷請(qǐng)求返回的狀態(tài)的,所以只要是返回的狀態(tài)碼是404的我們都把它跳過(guò),其他的都進(jìn)去爬取鏈接,這就解決了 url 的問(wèn)題了。

以下就是上述步驟的實(shí)現(xiàn)代碼。

def get_urls(self):

try:

for i in range(2015, 25000):

base_url = 'http://cn163.net/archives/'

url = base_url + str(i) + '/'

if requests.get(url).status_code == 404:

continue

else:

self.save_links(url)

except Exception, e:

pass

其余的就進(jìn)行的很順利了,網(wǎng)上找到前人寫的類似的爬蟲,但是只是爬取一篇文章的,所以借鑒了一下其正則表達(dá)式。自己用了 BeautifulSoup 還沒(méi)有正則效果好,所以果斷棄了,學(xué)海無(wú)涯啊。但是效果也不是那么理想,有一半左右的鏈接不能正確抓取,還需繼續(xù)優(yōu)化。

編程派:下面的代碼中 reload(sys);sys.setdefaultencoding('utf-8') 的做法是不推薦的,容易產(chǎn)生錯(cuò)誤。

# -*- coding:utf-8 -*-

import requests

import re

import sys

import threading

import time

reload(sys)

sys.setdefaultencoding('utf-8')

class Archives(object):

def save_links(self, url):

try:

data = requests.get(url, timeout=3)

content = data.text

link_pat = '"(ed2k://\|file\|[^"]+?\.(S\d+)(E\d+)[^"]+?1024X\d{3}[^"]+?)"'

name_pat = re.compile(

r'<h2 class="entry_title">(.*?)</h2>', re.S)

links = set(re.findall(link_pat, content))

name = re.findall(name_pat, content)

links_dict = {}

count = len(links)

except Exception, e:

pass

for i in links:

links_dict[int(i[1][1:3]) * 100 +

int(i[2][1:3])] = i # 把劇集按s和e提取編號(hào)

try:

with open(name[0].replace('/', ' ') + '.txt', 'w') as f:

print name[0]

for i in sorted(list(links_dict.keys())): # 按季數(shù)+集數(shù)排序順序?qū)懭?/span>

f.write(links_dict[i][0] + '\n')

print "Get links ... ", name[0], count

except Exception, e:

pass

def get_urls(self):

try:

for i in range(2015, 25000):

base_url = 'http://cn163.net/archives/'

url = base_url + str(i) + '/'

if requests.get(url).status_code == 404:

continue

else:

self.save_links(url)

except Exception, e:

pass

def main(self):

thread1 = threading.Thread(target=self.get_urls())

thread1.start()

thread1.join()

if __name__ == '__main__':

start = time.time()

a = Archives()

a.main()

end = time.time()

print end - start

完整版代碼,其中還用到了多線程,但是感覺沒(méi)什么用,因?yàn)?Python 的 GIL 的緣故吧,看似有兩萬(wàn)多部劇,本以為要很長(zhǎng)時(shí)間才能抓取完成,但是除去 url 錯(cuò)誤的和沒(méi)匹配到的,總共抓取時(shí)間20分鐘不到。搞得我本來(lái)還想使用 Redis 在兩臺(tái) Linux 上爬取,但是折騰了一番之后感覺沒(méi)必要,所以就這樣吧,后面需要更大數(shù)據(jù)的時(shí)候再去弄。

還有過(guò)程中遇到一個(gè)很折磨我的問(wèn)題是文件名的保存,必須在此抱怨一下, txt 文本格式的文件名能有空格,但是不能有斜線、反斜線、括號(hào)等。就是這個(gè)問(wèn)題,一早上的時(shí)間都花在這上面的,一開始我以為是抓取數(shù)據(jù)的錯(cuò)誤,后面查了半天才發(fā)現(xiàn)是爬取的劇名中帶有斜杠,這可把我坑苦了。

文章轉(zhuǎn)載:Python編程學(xué)習(xí)圈

(版權(quán)歸原作者所有,侵刪)

![]()

點(diǎn)擊下方“閱讀原文”查看更多