ECCV 2020 論文大盤點 - OCR 篇

點擊上方“AI算法與圖像處理”,選擇加"星標(biāo)"或“置頂”

重磅干貨,第一時間送達

來源:我愛計算機視覺

本文盤點?ECCV 2020?與?OCR 相關(guān)論文,包括?Text Detection(文本檢測)、Text Recognition(文本識別)、神經(jīng)架構(gòu)搜索+文本識別、文本超分辨率、Scene text spotting(將檢測和識別放一起,端到端文本識別)。

An End-to-End OCR Text Re-organization Sequence Learning for Rich-text Detail Image Comprehension

作者 |?Liangcheng Li, Feiyu Gao, Jiajun Bu, Yongpan Wang, Zhi Yu, Qi Zheng

單位 | 浙江大學(xué);阿里巴巴等

論文 |?https://www.ecva.net/papers/eccv_2020/

papers_ECCV/papers/123700086.pdf

備注 |?ECCV 2020

PlugNet: Degradation Aware Scene Text Recognition Supervised by a Pluggable Super-Resolution Unit

作者 |?Yongqiang Mou, Lei Tan, Hui Yang, Jingying Chen, Leyuan Liu, Rui Yan, Yaohong Huang

單位 | ImageDT圖匠數(shù)據(jù);華中師范大學(xué)

論文 |?https://www.ecva.net/papers/eccv_2020/

papers_ECCV/papers/123600154.pdf

備注 |?ECCV 2020

作者提出一個含有可插拔超分辨單元的端到端學(xué)習(xí)的文本識別方法(PlugNet),極大的解決了低質(zhì)量圖像識別的難題。

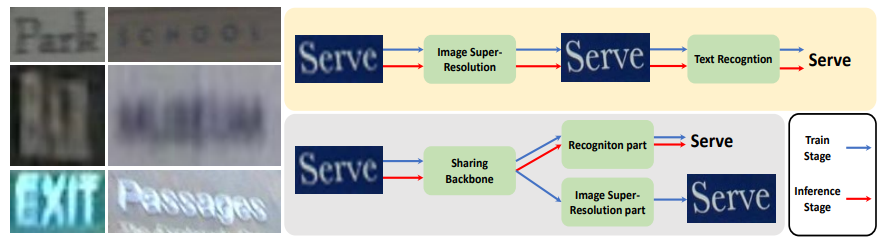

Adaptive Text Recognition through Visual Matching

作者 |?Chuhan Zhang,?Ankush Gupta,?Andrew Zisserman

單位 | 牛津大學(xué);DeepMind

論文 |?https://arxiv.org/abs/2009.06610

代碼 |?https://github.com/Chuhanxx/FontAdaptor

主頁?|?http://www.robots.ox.ac.uk/~vgg/research/FontAdaptor20/

備注 |?ECCV 2020

本文旨在解決文檔中文本識別的廣泛性與靈活性。引入一個新模型,利用語言中字符的重復(fù)性,將視覺表征學(xué)習(xí)和語言建模階段分離,將文本識別變成 shape matching 問題。

RobustScanner: Dynamically Enhancing Positional Clues for Robust Text Recognition

作者 |?Xiaoyu Yue,?Zhanghui Kuang,?Chenhao Lin,?Hongbin Sun,?Wayne Zhang

單位 | 商湯;西安交通大學(xué)

論文 |?https://arxiv.org/abs/2007.07542

備注 |?ECCV 2020

AutoSTR: Efficient Backbone Search for Scene Text Recognition

作者 |?Hui Zhang,?Quanming Yao,?Mingkun Yang,?Yongchao Xu,?Xiang Bai

單位 | 華中科技大學(xué);第四范式(北京)技術(shù)有限公司

論文 |?https://arxiv.org/abs/2003.06567

代碼 |?https://github.com/AutoML-4Paradigm/AutoSTR

備注 |?ECCV 2020

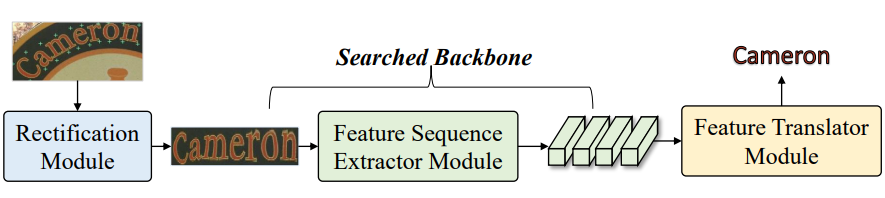

本項工作,作者受神經(jīng)架構(gòu)搜索(NAS)的成功啟發(fā),可以識別出比人類設(shè)計更好的架構(gòu)。提出自動STR(AutoSTR)來搜索依賴于數(shù)據(jù)的框架,以提高文本識別性能。

為STR設(shè)計了一個特定領(lǐng)域的搜索空間,其中包含了對操作的選擇和對下采樣路徑的約束。然后,提出一種兩步搜索算法,將操作和下采樣路徑解耦,在給定空間中進行高效搜索。

實驗證明,通過搜索數(shù)據(jù)相關(guān)的骨干,AutoSTR可以在標(biāo)準(zhǔn)基準(zhǔn)上以更少的FLOPS和模型參數(shù)超越最先進的方法。

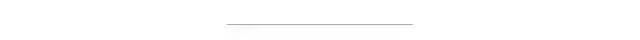

Scene Text Image Super-resolution in the wild

作者 |?Wenjia Wang,?Enze Xie,?Xuebo Liu,?Wenhai Wang,?Ding Liang,?Chunhua Shen,?Xiang Bai

單位 | 商湯;香港大學(xué);南京大學(xué);阿德萊德大學(xué);華中科技大學(xué)

論文 |?https://arxiv.org/abs/2005.03341

代碼 |?https://github.com/JasonBoy1/TextZoom

備注 |?ECCV 2020

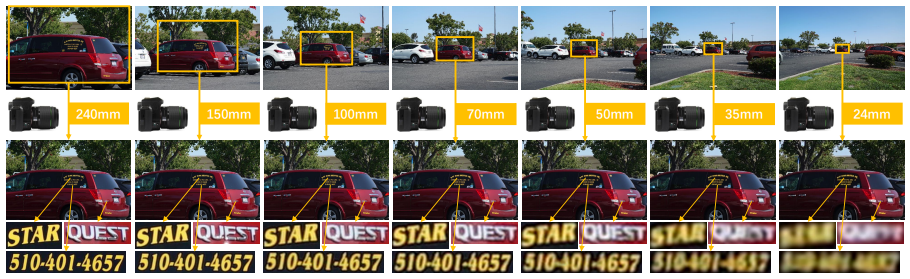

介紹了第一個真正意義上的配對場景文本超分辨率數(shù)據(jù)集TextZoom,采用不同的焦距。用三個子集來標(biāo)注和分配數(shù)據(jù)集:分別是簡單、中等和困難。

通過比較和分析在合成LR和提出的LR圖像上訓(xùn)練的模型,證明了所提出的數(shù)據(jù)集 TextZoom 的優(yōu)越性,并從不同方面證明了場景文本SR的必要性。

另外該問還提出一個新的文本超分辨率網(wǎng)絡(luò),有三個新穎的模塊。通過在TextZoom上的訓(xùn)練和測試,以及公平的比較,證明它明顯超過了7種有代表性的SR方法。

Scene text spotting

Mask TextSpotter v3: Segmentation Proposal Network for Robust Scene Text Spotting

作者 |?Minghui Liao,?Guan Pang,?Jing Huang,?Tal Hassner,?Xiang Bai

單位 | 華中科技大學(xué);Facebook AI

論文 |?https://arxiv.org/abs/2007.09482

代碼 |?https://github.com/MhLiao/MaskTextSpotterV3

解讀|Mask TextSpotter v3 來了!最強端到端文本識別模型

備注 |?ECCV 2020

目前的方法多用 RPN 來進行 integrating detection and recognition(集檢測與識別一體)的場景文本檢測,但在極端長寬比或不規(guī)則形狀的文本以及密集定向的文本中進行操作有一定的困難。

因此,本文提出Mask TextSpotter v3,一個端到端可訓(xùn)練的場景文本發(fā)現(xiàn)器,采用 Segmentation Proposal Network (SPN) 來代替 RPN。SPN是無錨的,可以準(zhǔn)確地表示任意形狀的提案,所以優(yōu)于 RPN。Mask TextSpotter v3 可以處理極端長寬比或不規(guī)則形狀的文本實例,并且識別精度不會受到附近文本或背景噪聲的影響。

具體來說,在Rotated ICDAR 2013數(shù)據(jù)集上的表現(xiàn)比最先進的方法高出21.9%(旋轉(zhuǎn)魯棒性),在Total-Text數(shù)據(jù)集上的表現(xiàn)比最先進的方法高出5.9%(形狀魯棒性),在MSRA-TD500數(shù)據(jù)集上的表現(xiàn)也達到了最先進的水平(長寬比魯棒性)。

AE TextSpotter: Learning Visual and Linguistic Representation for Ambiguous Text Spotting

作者 |?Wenhai Wang,?Xuebo Liu,?Xiaozhong Ji,?Enze Xie,?Ding Liang,?Zhibo Yang,?Tong Lu,?Chunhua Shen,?Ping Luo

單位 |?南京大學(xué);商湯;香港大學(xué);阿里巴巴;阿德萊德大學(xué)

論文 |?https://arxiv.org/abs/2008.00714

代碼 |?https://github.com/whai362/TDA-ReCTS

備注 |?ECCV 2020

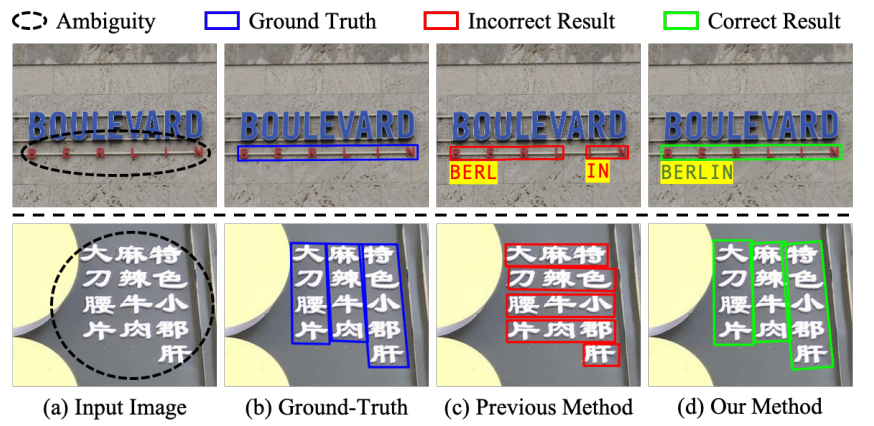

問題:字符之間的間距較大或字符均勻分布在多行多列時,會發(fā)生歧義,使得許多視覺上可信的字符分組。

方案:提出一種新型文本發(fā)現(xiàn)器,消除歧義文本發(fā)現(xiàn)器(AE TextSpotter),可以同時學(xué)習(xí)視覺和語言特征,以顯著降低文本檢測的歧義性。

優(yōu)點:1、語言表征與視覺表征在同一框架,作者表示是第一次利用語言模型來改進文本檢測。

2、利用精心設(shè)計的語言模塊降低了錯誤文本行的檢測置信度,使其在檢測階段容易被修剪。

3、實驗表明,AE TextSpotter比其他SOTA方法有很大的優(yōu)勢。例如,從IC19-ReCTS數(shù)據(jù)集中精心挑選了一組極度模糊的樣本進行驗證,所提出方法超過其他方法4%以上。

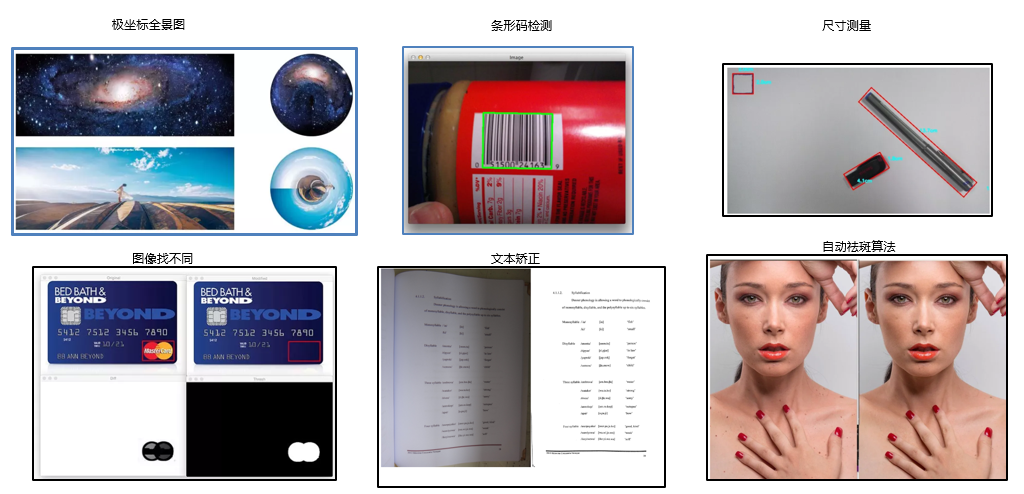

下載1:OpenCV黑魔法

在「AI算法與圖像處理」公眾號后臺回復(fù):OpenCV黑魔法,即可下載小編精心編寫整理的計算機視覺趣味實戰(zhàn)教程

下載2 CVPR2020 在「AI算法與圖像處理」公眾號后臺回復(fù):CVPR2020,即可下載1467篇CVPR?2020論文 個人微信(如果沒有備注不拉群!) 請注明:地區(qū)+學(xué)校/企業(yè)+研究方向+昵稱

覺得有趣就點亮在看吧